○26年2月24日の勉強会「AI×OD/HRDの未来を探る」の担当文献+α(3本)

===

Loso Judijanto(2025) Artificial Intelligence in HRM: A Scientometric Review of Global Publications.West Science Business and Management Vol. 3, No. 03, September 2025, pp. 782~791.

・Scopusのデータベースを使い、HRMにおけるAI関連の文献を「Scientometric(サイエンメトリクス)科学計量学」*でレビューした。

*科 学 計 量 学 ( Scientometrics) は 、 科 学 を 科 学 す る( Science of Science)学 問 として 、科 学 活 動 の 説 明 を 計量を用いて実施するもの と し て 発 展 し て き た 。(参考文献)

・2000年~2025年に、英語で発表された文献のみを対象にした。

・VOSviewer softwareを使い可視化した。

・共著者のネットワーク

・研究機関のネットワーク

○図が逆さま?反転している?

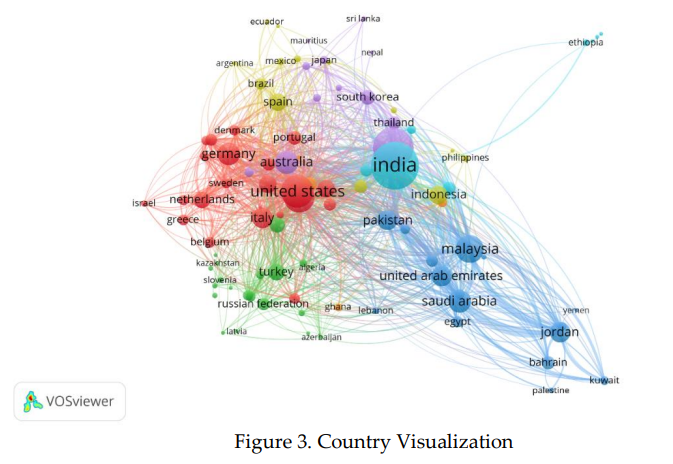

・研究が盛んな国:インド、US、マレーシア

・キーワード

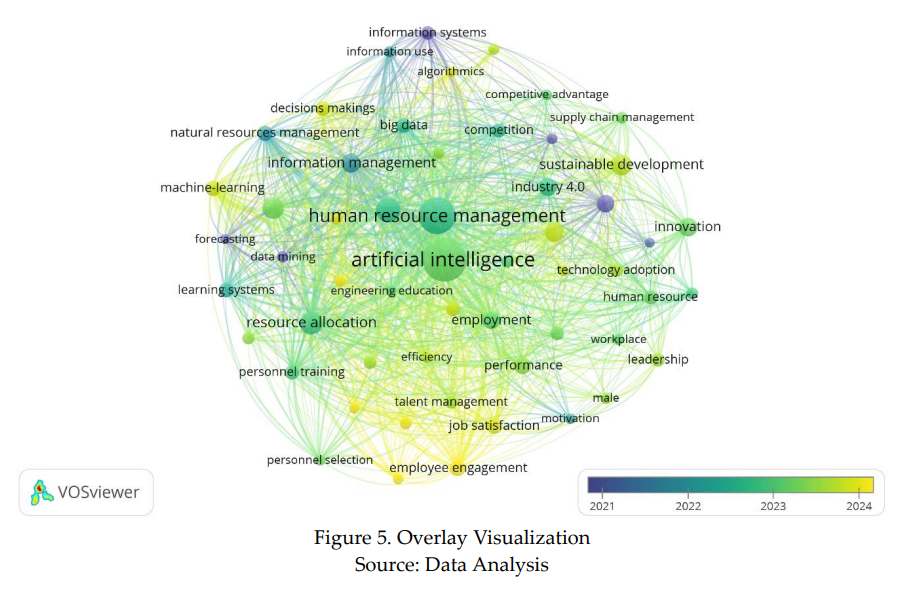

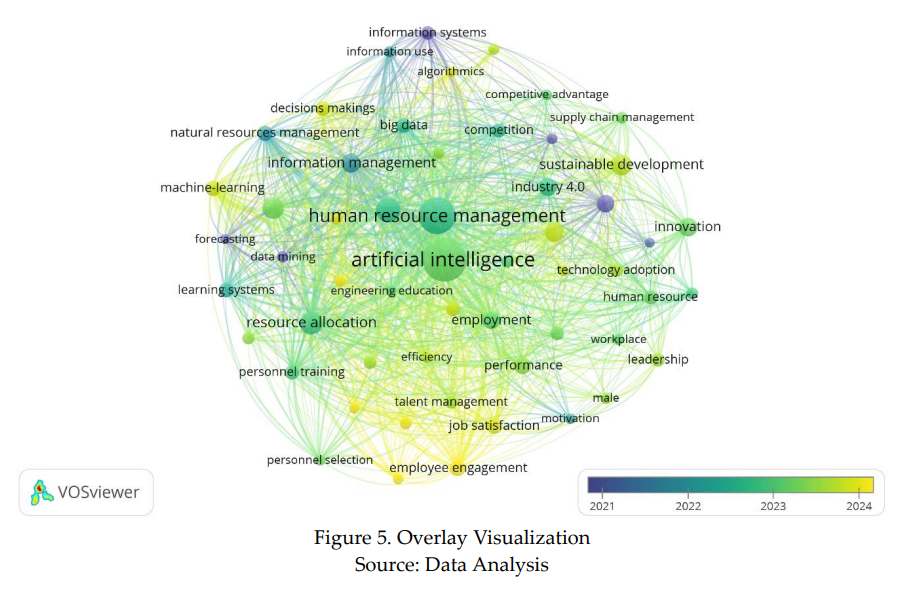

・2021年~2022年の記事は、AIに関する技術的な文献が多い

・2023年~2024年になると、AIを使い従業員体験を向上させようとする文献が増える。

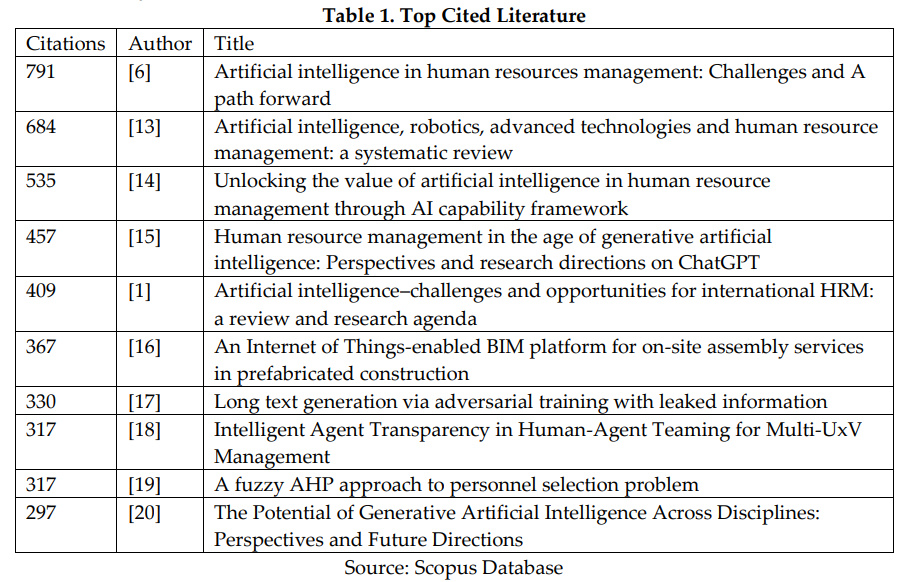

・被引用数の多い文献

・AIに関する文献は、技術的実現性から、戦略的実装と人間中心の結果に、興味関心が移ってきている。

・本稿の限界は、Scorpusのデータベースのみであること、著者が選んだキーワードであること、定性研究は取り上げていないことである。

===

Budhwar, P., Chowdhury, S., Wood, G., Aguinis, H., Bamber, G. J., Beltran, J. R., Boselie, P., Lee Cooke, F., Decker, S., DeNisi, A., Dey, P. K., Guest, D., Knoblich, A. J., Malik, A., Paauwe, J., Papagiannidis, S., Patel, C., Pereira, V., Ren, S., Rogelberg, S., Saunders, M. N. K., Tung, R. L.,Varma, A. (2023). Human resource management in the age of generative artificial intelligence: Perspectives and research directions on ChatGPT. Human Resource Management Journal, 33(3), 606–659.

・生成AI時代のHRM:ChatGPTに関する視点と研究の方向性

・23名の著者によるInvited Review(招待レビュー論文)

1 | THE RISE OF GENERATIVE AI – UNRAVELLING THE KNOWNS AND UNKNOWNS

・過去5年間、AIに関するHRM文献は増えている。

・ChatGPTは、単なる文章予測から進化している。

・Outputの質は、Inputの質による。

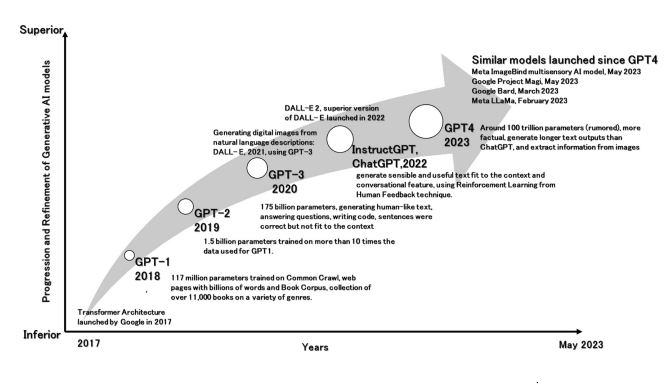

・ChatGPTの進化

・Dr.Geoffrey Hinton(Godfather of AI AIの生みの親)は、生成AIのリスクについても警告していた。

・本レビューでは、Section2~5にかけて、11の視点を提供する。

‐‐‐

2 | GENERATIVE AI BUSINESS IMPLICATIONS AND HRM OUTCOMES

2.1 | What can we learn about Disruptive Technology and Business Implications from Business History?

・チャップリンの「モダンタイムス」が描いたような人間が機械に服従する世界。

・J.キャメロンの「ターミネーター」シリーズは、機械の奴隷になる不安を描いていた。

・AIは、生産性を高めるが、我々の批判的思考能力を下げるかもしれない。

・AIに頼ると、似たようなOutput成果物になりやすい。

・人間は、機械のペースについていけない。

・AIの使用には、環境コストもかかっている。

・個人が起業家的に、AIを特定の専門分野に使うのか、大企業のみがAIを活用するのか

・AIは、Perfect完璧になる必要はないが、我々よりBetter良くなっていくだけだろうし、既にそうなっている。

‐‐‐

2.2 | Open Resource Based View – ChatGPT and strategy to deploy it within HRM

・伝統的なリソースベースドビューを用い、AIのポジティブとネガティブな効果について述べて上で、別の枠組みとして、オープンリソースベースドビューを提示したい。

・ChatGPTは、誰にでも無料で使える。人々の間での競争優位性が必要になる。

・AI活用は、HR部門内でも費用効果が高い。ChatGPTへの外注も増えるだろう。

・伝統的なリソースベースドビューでは、個別企業に焦点をあてている。

・オープンリソースベースドビューは、組織、個人(従業員と市民)そして社会に視野を広げる。

‐‐‐

2.3 | The Implications of Generative Artificial Intelligence for HRM-Related outcomes:

Analysis and Research Implications

・AIは、大量の情報を、速いスピードで処理する。

・AIに関する研究では、2つの分析枠組みがある。

1)ステークホルダー・アプローチ(Beer et al.1984)

2)ソシオテクニカル・アプローチ(Breque et al.2021、Trist et al.1963)

・AIはルーチン活動を減らしてくれる。

‐‐‐

3 | GENERATIVE AI – EMPLOYEE RELATIONS, WELLBEING, TALENT AND

PERFORMANCE MANAGEMENT

3.1 | ChatGPT impact on employment relations, employee wellbeing and engagement

・従業員‐雇用主関係においては、Trust信頼こそが、中心要因である。

・AIによるセラピーが、うつ症状の減少につながった(Fitzpatrick et al.2017)

・ChatGPTに「Can I trust you?」「I feel depressed」等、質問した(AIからの回答を転載している)

‐‐‐

3.2 | What are Implications and Challenges of ChatGPT and other generative AI-Driven

Tools for Employment Relations?

・AIのような発明は、人間の介入と監視が必要である。

・AIにより、誰が困り、誰が得をするのか。

・AIも古いコンピューターと同じで、Garbage in, Garbage out(GIGO)である。

‐‐‐

3.3 | ChatGPT Talent Management and Advising Managers on Performance Management

・Performance managementでは、データに基づき判断するRater考課者が必要である。

・このデータの扱いをAIに任せることには危険もある。

・ChatGPTは、まだ、個々の従業員にフィードバックする準備はできてない。

・Performance managementは、human process人間的なプロセスであり、AIで代替はできず、あくまで、人間をAssistアシストするのみである。

・Performance managementの研究者は、個人のパフォーマンスと組織レベルの成果の明確なつながりを提示でてきない。

・ChatGPTは、考課者を少し楽にしてくれる可能性がある。

‐‐‐

4 | GENERATIVE AI – IHRM, EDI AND SUSTAINABLE HRM

4.1 | The Promises and Perils of Generative AI: An International Human Resource

Management Research Agenda

・Generative生成AIは「新しいコンテンツ」の作成に合い、Discriminative識別型AIは、分析に合う。

・生産性のパラドックスである「Jカーブ」新しい技術は、最初生産性を下げ、その後あげていく。

・Diversity多様性は、短期的には葛藤と意見の不一致をもたらすが、Creativity創造性の向上につながる。

・ChatGPTが使うデータベースのほとんどは英語である。

‐‐‐

4.2 | ChatGPT, EDI and implications for HRM

・Equity,Diversity,and Inclusion(EDI)

・IT産業での40歳以上は、リスクにさらされている。

・AIが意思決定に関与するようになると、マネジャーは、道徳的に無関心な状態になる恐れがある(Bandura,1999)

・AIにより、Personalized training and development 個別化した研修と開発が可能になるか。

・AIにより、よりポジティブで生産的なリモートワーク環境を作れないか。

‐‐‐

4.3 | Generative AI and sustainable HRM

・伝統的なMarket-oriented model市場志向モデル(Ren et al.2023)

・AIは、Future employment将来雇用の破壊につながる恐れがある。

・低い技術の仕事は、自動化にとって代わられる。

・Critical Thinkers批判的思考者という新しい仕事役割が生まれるかもしれない。

・AIによる大量のエネルギー消費は、持続可能なものなのか。

○確かに、AIによる大量の水利用は、不安になるよな~。

・Goldman Sachs(2023)は、AIの影響は、香港、イスラエル、日本、スウェーデン、USで強く、インド、インドネシア、パキスタン、フィリピン、ベトナムでは弱いと報告している。

○どういうこと?

‐‐‐

5 | GENERATIVE AI AND ACADEMIC RESEARCH METHODS

5.1 | Insights and recommendations from a research methods’ conversation with

ChatGPT

・研究者が、AIを無批判に使うのは無責任であり、AIをどう使うかは、研究者の責任範囲である。

・研究者は、疑問に思い、懐疑的な姿勢を持つよう訓練されている。

・定性的な研究を専門にしている私(Saunders)の論文は、AIに引用されなかった。

・ChatGPTは、並べ替え、再現、整理が得意である。

・ChatGPTは、同じ質問をしても、違う答えが返ってくる。

・ChatGPTは、最新の研究を引用できない。

・生成AIを使う際には、Transparent透明であることが必要。

・生成AIは、ツールであり、共著者ではない。

‐‐‐

5.2 | Using generative AI as a methodology assistant: Trust, but verify

・Purcell and Hutchinson(2007)の文献は、ここ最近でもっともインパクトのあったものだ。

○これ面白そう。読んでみよう。

・生成AIをアシスタントとして使う。

○研究者もおっかなびっくりだよな~。どこまで信頼していいのか。

・Feast or Famine 豊作か飢餓か AIの回答は、too many, too few, or too general 多すぎるか少なすぎるか、一般論すぎるか。

・AIは、補完的ツールであるが、研究者の判断を代替することはできない。

・Trust but verify 信頼するが、確認する。

‐‐‐

6 | AI, ECONOMY, SOCIETY AND HRM: POSSIBILITY, UNCERTAINTY AND RISK

・他の新技術と同じように、AIがどうなっていくかは、しばらく時がたたないと分からない。

・データの入力と分析は、より自動化されるであろう。

・AIを設計する人間の倫理観は問われるだろう。

・AIが出す結果に対して、人間がレビューすることになるだろう。

・AIにより、Review articlesレビュー論文の将来については、議論になるだろう。

○確かに、レビュー論文なら、AIに書けちゃうかも。人間が書く意味を見出していかないとな~。

・HRMは、人間についてのものである。(AIには限界がある)

===

Peter Cappelli, Prasanna Tambe, and Valery Yakubovich(2019)Artificial intelligence in human resources management: Challenges and a path forward

○被引用件数が1番多かったレビュー論文。

===

コメントフォーム